噩梦系统,噩梦系统的定义与背景

时间:2024-12-11 来源:网络 人气:

噩梦系统的定义与背景

在科技飞速发展的今天,人工智能(AI)技术已经渗透到我们生活的方方面面。随之而来的是一系列关于隐私、安全以及伦理的问题。其中,“噩梦系统”这一概念,便是这些问题的集中体现。所谓噩梦系统,指的是那些在设计和实施过程中,可能对用户造成严重负面影响,甚至侵犯用户隐私的AI系统。

噩梦系统的典型特征

噩梦系统通常具有以下特征:

隐私泄露:系统在收集、存储和使用用户数据时,可能存在安全隐患,导致用户隐私泄露。

功能滥用:系统功能被滥用,可能对用户造成伤害,如微软的AI截图工具Recall,在未经用户同意的情况下,收集用户电脑上的所有内容。

决策偏见:系统在决策过程中存在偏见,可能对某些群体造成不公平待遇。

不可解释性:系统决策过程不透明,用户难以理解其决策依据。

噩梦系统的案例分析

案例一:微软AI截图工具Recall

微软的AI截图工具Recall,在2024年5月发布时,因涉嫌侵犯用户隐私而备受争议。该工具旨在通过搜索用户过去的活动,包括文件、照片、电子邮件和浏览历史,帮助用户找到他们以前查看过或处理过的东西。这一功能在未经用户同意的情况下,收集了大量敏感数据,引发了广泛的担忧。

案例二:格子达查重系统

格子达查重系统是一款用于检测论文抄袭的软件。该系统在自动匿名化功能上存在bug,导致部分用户论文页码出现错误。此外,该系统在查重判定上存在争议,导致许多不同领域的文章被判定为重复,引发了用户的不满。

如何应对噩梦系统

面对噩梦系统,我们需要采取以下措施:

加强监管:政府、企业和用户应共同努力,加强对AI系统的监管,确保其合规、安全、可靠。

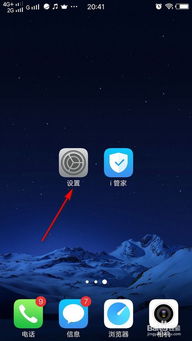

提高用户意识:用户应提高对AI系统的认识,了解其潜在风险,并学会保护自己的隐私。

技术创新:研发者应注重AI系统的伦理和安全性,确保其在设计和实施过程中,不会对用户造成伤害。

噩梦系统是AI技术发展过程中的一大挑战。只有通过加强监管、提高用户意识和技术创新,我们才能确保AI技术在为人类带来便利的同时,避免其成为噩梦。

相关推荐

教程资讯

教程资讯排行